谷歌发布 TurboQuant AI 压缩算法,可将大语言模型内存占用降低 6 倍

在生成式 AI 模型日益普及的今天,内存占用和计算效率一直是制约其大规模部署的关键瓶颈。谷歌研究院近日公布了一项名为 TurboQuant 的新型压缩算法,旨在显著降低大语言模型(LLMs)的内存使用量,同时提升推理速度并保持输出质量。这项技术通过优化模型中的 键值缓存(key-value cache) 来实现高效压缩,有望为 AI 应用的边缘部署和成本控制带来突破。

为什么内存压缩如此重要?

大语言模型在推理过程中需要维护一个庞大的 键值缓存,谷歌将其形象地比喻为“数字小抄”。这个缓存存储了模型在处理序列时生成的关键信息,以避免重复计算。然而,这些信息通常以高维向量的形式存在,每个向量可能包含数百甚至数千个嵌入(embeddings),用于描述文本、图像等复杂数据的语义含义。正是这些高维向量导致了缓存体积的急剧膨胀,不仅占用大量内存,还成为性能瓶颈,拖慢推理速度。

为了缓解这一问题,业界普遍采用 量化(quantization) 技术,通过降低数值精度来压缩模型。但传统量化方法往往以牺牲输出质量为代价——模型在 token 估计上的准确性会下降,影响生成内容的连贯性和可靠性。

TurboQuant 如何实现“无损”压缩?

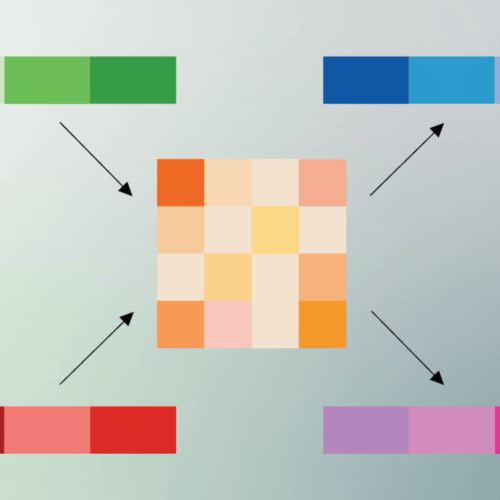

TurboQuant 的核心创新在于其两阶段压缩流程,其中第一步 PolarQuant 尤为关键。与通常使用标准 XYZ 坐标编码向量的方式不同,PolarQuant 将向量转换为极坐标系下的表示。在这一体系中,向量被简化为两个核心信息:

- 半径(radius):代表核心数据的强度

- 方向(direction):表征数据的语义含义

谷歌用一个生动的类比来解释这一转换:传统编码好比指令“向东走 3 个街区,向北走 4 个街区”,而极坐标表示则简化为“沿 37 度方向走 5 个街区”。这种表示不仅占用更少的存储空间,还避免了昂贵的数据归一化步骤,为后续的高效压缩奠定了基础。

性能提升与行业影响

根据谷歌公布的早期测试结果,TurboQuant 在部分场景下实现了:

- 内存使用量降低 6 倍

- 性能提升最高达 8 倍

- 且未观察到输出质量损失

这一突破意味着,未来 AI 模型可以在资源受限的设备(如智能手机、嵌入式系统)上更高效地运行,同时降低云服务商的硬件成本。对于开发者而言,TurboQuant 可能开启新一轮模型优化竞赛,推动轻量级、高性能 AI 应用的普及。

展望与挑战

尽管 TurboQuant 展现了令人瞩目的潜力,但其实际部署仍面临一些未知数:

- 算法在不同模型架构和任务上的泛化能力如何?

- 压缩过程是否会引入额外的计算开销?

- 谷歌是否会将其开源或集成到主流框架中?

无论如何,TurboQuant 的出现标志着 AI 模型压缩技术正从“牺牲质量换效率”向“鱼与熊掌兼得”迈进。随着边缘计算和实时 AI 应用需求的增长,这类高效压缩算法将成为推动行业下一波创新的关键引擎。